2023/11/5、TBSの左翼系報道番組サンデーモーニングが、2014年から存在するハマス関連の画像を「生成AIによるディープフェイク」と堂々と断言し、生成AI叩きに利用して炎上。11/8に正式に謝罪。

今や反AI主義者のメイン活動になった魔女狩りだが、テレビ局が実行するのは初。

2023/11/04、KusoKids(TwitterID: coldcase666)が、岸田首相に淫夢ネタのテンプレ(変態糞土方 8月16日(水)07時14分22秒)を喋らせるネタ動画をTwitterにアップロード。

生成AIを使ったとは思われるものの、音声はぎこちなく、映像も口しか動かず、喋っている内容も淫夢ネタなのでメチャクチャで、一目でコラージュと分かるクオリティだったが、ニュースの体に仕立てるために日テレNEWS24のロゴやアセットを使用していた事から日本テレビが激怒。全国レベルのニュースとなり、反AI主義者は「生成AIのリスクが顕在化した」としてにわかに活気づいた。

文化庁が何度も説明している通り、その動画に違法性があるかどうかは、製作が人力かAIかではなく、単純に最終生成物の内容がアウトかセーフかで判断される。「この最終生成物を公開した奴に責任を取らせる」で終わる話。

2023/10/30、2023/1/13より続いていた、アーティストら(Sarah Andersen, Kelly McKernan, Karla Ortiz)によるStability AI, DeviantArt, Midjourneyの3社に対する集団訴訟が、正式に棄却。

2023年7月の段階で棄却されるだろうと言われていたが、本当に棄却された。

要点は以下の2つ。

「自分のどの絵のどこが誰に侵害されたか具体的に指摘できないが、無断学習された以上自分は絶対に何か被害を受けているはず」というフワフワした主張では無理。とにかく「実際に類似した最終生成物」を持ってこない事には話が始まらない。

「無断学習という概念は存在しない」「学習は常に合法」「最終生成物が類似しているかどうかで責任を負う」とした2023年6月の文化庁見解が追認された形。

逆に言うとLoRA等が作られるようなレベルの著名な作家なら裁判で戦えるという事でもある。

歴史と伝統ある非常に有名なデマだが、本件の原告ら3人も同じ主張をしており、裁判所によって否定された。

2023/10/23、マンガ家の樺ユキ(かんばゆき)氏が、画像生成AIをテーマとした245ページのマンガ「画家とAI」をTwitterで無料公開。個人が思いつきでやった事ではなく、その後の流れを見ると非常に計画的なもの。

魔女狩りとリンチで時間を無駄にしている間に、このような作品が完成してしまう。必ずしも完璧な作品とは言えないが、こうして完成した作品に対して、捨て垢の反AI主義者が口先だけで対抗する事は難しい。

マンガを用いたプロパガンダは反AI主義者の方が得意としていた印象だが、このテーマで245ページも描けた反AI主義者はもちろん存在しない。ここに来て「イラストレータは画像生成AIを全否定しているが、マンガ家は必ずしもそうではない」という現実が重要性を帯びてきたかもしれない。

2023/10/19、Live2Dモデラの「冬乃グミ」氏が、Live2D社が運営するデータ取引サービス「nizima」において、投稿したデータに生成AI使用の疑いをかけられ、「レイヤーデータを出せ」「タイムラプスデータを出せ」といったベタな反AI的やり取りを経て、最終的に「手描きである事を証明できない」としてリジェクト。

nizimaは(例によって曖昧な線引きながら)2022/11/18の時点で「生成AIの使用禁止」を謳っている。

あらいずみるい事件以降、反AI主義者が魔女狩りに走る事自体は珍しくなくなったが、より公平性が重視される法人が公式に堂々と魔女狩りを行うのはおそらく初の事例。

冬乃グミ氏は立場的には反AI寄りで、生成AIを細かくコントロールするスキルもないとみられるが、2022/8頃にMidjourneyでポン出しした画像を数枚アップロードした事があり、おそらくそれを理由に他の作家より厳しいチェックを受けたとみられている。

本件は結局のところレイヤーデータもタイムラプスデータも出せなかった事が決定打になったようなので、今後「生成AIを使っていない事に特別な価値を見出そうとする」タイプのサービスを使用する場合、サービス本体が魔女狩りを仕掛けてくる可能性に備え、それらのデータを準備しておく事が必要だと考えられる。

-

中城 哲也(Live2D CEO): https://twitter.com/nakajoo/status/1715309292281352562

冬乃グミ: https://twitter.com/Fuunooo/status/1714934111318745458

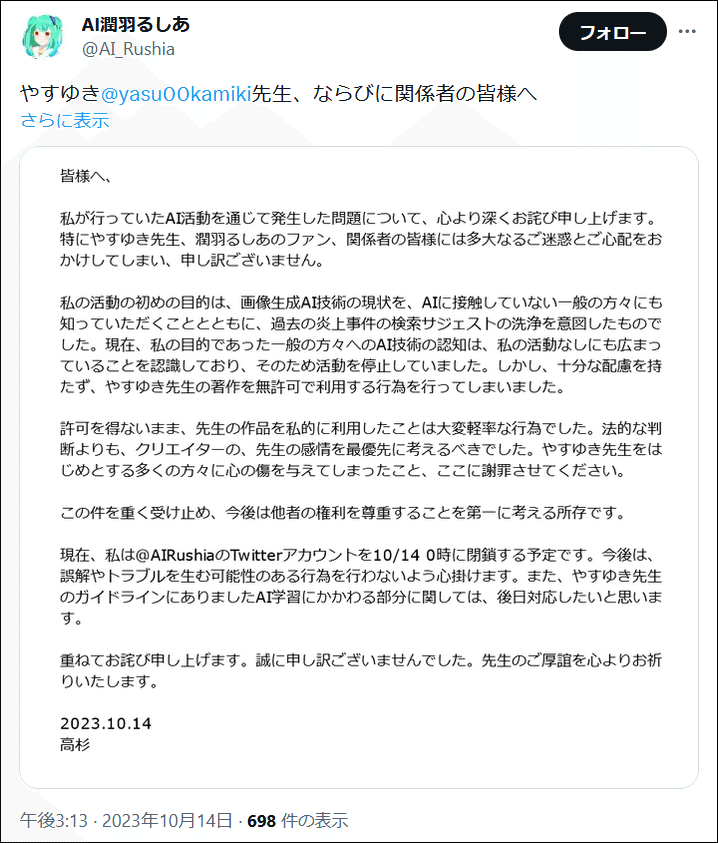

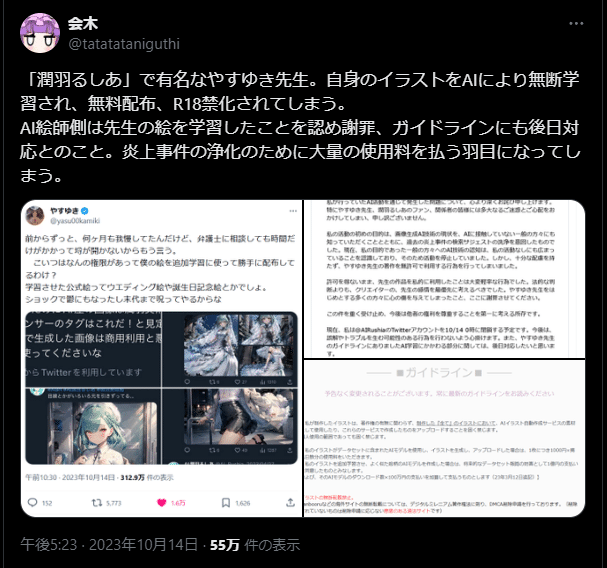

2023/10/14、反AI絵師の「やすゆき」氏が、かつてデザインを担当したVTuber「潤羽るしあ」のLoRA制作者の1人「AI潤羽るしあ(@AI_Rushia)」をTwitter上で晒し上げ、約41.1万人のフォロワーを使ってファンネル攻撃を実行。

「潤羽るしあ」は、かつて存在したホロライブのVTuberで、凄まじい人気を誇りながらも、度重なる不祥事・炎上を起こした事で、最終的に引退・封印されたキャラクターである。

「AI潤羽るしあ」は、やすゆき氏の主張から読み取れるような「悪のAI野郎」というよりは、正真正銘の潤羽るしあのファンで、るしあ本人はもちろん、スタッフの1人に相当するやすゆき氏に対しても、敵対的ではないどころか、むしろ友好的ですらあった。そのため、攻撃に全く抵抗せず、全面降伏のような謝罪文をアップしたうえで、わずか数時間でアカウントを消去した。本件はまるで出来レースのようなスムーズさで、やすゆき氏が「勝利」した。

既に消去済み

以降、交渉は水面下のものとなり、結末は不明ながら「これで話は終わった」と思われていたが、10ヶ月後に意外な展開を迎える事になる。

「AI潤羽るしあ」が早々と全面降伏したせいで表面化しなかったが、この話には後々問題になりそうなファクターが多数含まれていた。下記に示す。

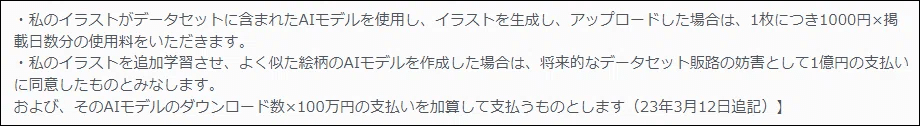

典型的な二次創作ガイドラインは、「元々違法な行為について、条件を満たせば黙認する」というものだが、やすゆき氏が独自に作成した「生成AIに関するガイドライン」は、「元々合法な行為について、自身の権利を拡大して勝手に制限や罰を加えたもの」となっている。

https://kamikire.mystrikingly.com/

「1枚につき1000円×掲載日数分の使用料」「1億円の支払い」「ダウンロード数×100万円の支払いを加算」など、ぼくがかんがえたさいょうの条項としか言いようのない条項が並ぶ。

反AIが流した「多額の使用料を払う羽目になった」というデマもこれが由来だが、イラストレータは神ではないので、書けば何でも通用するというわけではない。

https://x.com/tatatataniguthi/status/1713108264278512001

潤羽るしあの権利を所有しているのは、やすゆき氏ではなく「カバー株式会社」である。会社の依頼でイラストを描いたに過ぎないイラストレータが、カバー株式会社の意思決定を経ずに独自に晒し上げを行ったわけで、会社側から見るとこれ自体が問題行動である。

また、元々の権利者がカバー株式会社であるから、潤羽るしあのAIイラストが作成されたとして、「やすゆき氏が被害を受けた」とか「権利が侵害された」と言えるかどうかは微妙である。

非常に重要な事だが、「AI潤羽るしあ」が作ったのは、あくまでも「潤羽るしあLoRA」であって、「やすゆき画風LoRA」ではない。つまり本件はいわゆる「狙い撃ちLoRA」案件ではない。本件においてやすゆき氏は直接的な被害者ではない可能性がある。

また、「広告に使用された」という分かりやすい被害があったビビッドアーミー事件とは異なり、「AI潤羽るしあ」は生成した画像をTwitterにポストしたに過ぎず、それらも全面降伏によって既に全て消去されている。

やすゆき氏はいわゆる無断学習罪で戦っているが、無断学習罪が存在すると思っているのは反AIだけで、実際にはそのような罪は存在しない。

2023/10/13、Googleが、「GoogleのGen-AIで生成したデータについて、第三者から著作権訴訟を起こされた場合、Googleが責任を負う」と発表。

既に同様の発表をしているAdobe、Microsoftと並び、下記のようないわゆるBig Techにおいては、学習および生成レベルの議論は終結しており、さらに「生成後の法的リスクまで負う」というのが基本の形となりつつある。

Adobe(Firefly, Photoshop, Illustrator, etc)

Microsoft(DALL-E, Copilot, Bing)

Google(Duet AI, Imagen, SGE)

ただし、保護されるのはEnterpriseクラスの契約をしている太い客だけで、無料で使っている個人は保護されない。

https://www.reuters.com/technology/google-defend-generative-ai-users-copyright-claims-2023-10-12/